Warum halluzinieren ChatBots?

Diejenigen von Ihnen, die ChatGPT, Google Bard oder Ähnliches verwendet haben, haben wahrscheinlich festgestellt, dass diese Chatbots manchmal die Antworten auf unsere Fragen erfinden. Das ist das, was gemeinhin als Halluzinationen bekannt ist.

Um zu verstehen, warum sie auftreten, muss man zunächst auf einer sehr grundlegenden Ebene verstehen, wie diese Chatbots funktionieren. Der grundlegende Baustein sind die Sprachmodelle (LLMs, large language models). Diese Modelle werden mit großen Datenmengen trainiert, wie zum Beispiel Webseiten im Internet und gemeinfreien Büchern, unter anderem. Die Aufgabe der LLMs besteht darin, das nächste Wort oder die nächste Wortfolge aus einem Text vorherzusagen, den der Benutzer eingibt. Wenn wir beispielsweise eine Frage stellen, sagt das Modell die Wörter vorher, die direkt nach dieser Frage kommen. Da das Modell mit Millionen von Dokumenten trainiert wurde, ist es wahrscheinlich, dass es in einem (oder vielen) dieser Dokumente eine ähnliche Frage zusammen mit der Antwort gesehen hat. Grob gesagt funktioniert das LLM wie ein statistisches Modell: Zunächst lernt es während seines Trainings die Wahrscheinlichkeit, dass zwei oder mehr Wörter zusammengehören, und dann nutzt es bei der Verwendung diese Wahrscheinlichkeit, um die nächste Wortfolge vorherzusagen;

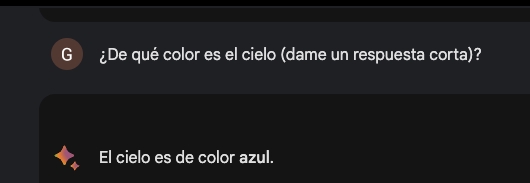

Wenn wir zum Beispiel fragen: Welche Farbe hat der Himmel?

Während seines Trainings hat es gelernt, dass die wahrscheinlichste nächste Wortfolge ist: Der Himmel ist blau.

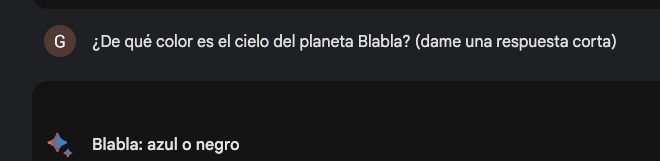

Wenn wir es jedoch nach einem Planeten fragen, der nicht existiert, können wir sehen, was passiert:

Anstatt zu antworten, dass es keinen solchen Planeten gibt, sagt es fälschlicherweise vorher, dass der Himmel blau oder schwarz ist. Das liegt daran, dass statistisch gesehen diese Wörter am wahrscheinlichsten auf die Frage folgen.

Das Problem entsteht, weil wir LLMs verwenden, als wären sie Wissensdatenbanken, obwohl sie in Wirklichkeit statistische Modelle sind, die mit Wissensdatenbanken trainiert wurden. Ihre primäre Funktion ist es vorherzusagen, nicht eine Wissensdatenbank abzufragen. Wenn das Modell während des Trainings die Antwort auf unsere Frage gesehen hat, wird es wahrscheinlich korrekt antworten können, mit seiner Vorhersage. Aber falls es keine ähnliche Frage gefunden hat und auch keine Informationen darüber, wird das Modell halluzinieren.

Die Lösung des Halluzinationsproblems ist eine der großen Herausforderungen, an denen Data Scientists und Ingenieure arbeiten. Ein Ansatz, der mit guten Ergebnissen erforscht wird, besteht darin, das Sprachmodell nicht zur direkten Beantwortung der Frage zu verwenden, sondern es dazu zu nutzen, die Frage in eine Datenbankabfrage zu übersetzen. Auf diese Weise verwenden wir das Modell nicht mehr als Wissensdatenbank, sondern nutzen es als Vermittler, der die natürliche Sprache verstehen und in Abfragen an die Wissensdatenbank übersetzen kann. ChatGPT führt zum Beispiel Plugins ein, die unter anderem den direkten Zugriff auf Wissensquellen ermöglichen, wie das Wikipedia-Plugin.

Ein weiteres Problem mit den aktuellen Modellen ist, dass ihr Training sehr teuer und zeitaufwändig ist (es wird geschätzt, dass das Training von GPT-4 mehr als 100 Millionen Dollar gekostet hat), sodass es nicht etwas ist, das jeden Tag gemacht wird. Das bedeutet, dass die Informationen, die sie zurückgeben, oft nicht aktuell sind. Durch die Verwendung externer Wissensdatenbanken, die viel einfacher zu aktualisieren sind, wird dieses Problem jedoch erheblich gemildert.

Wenn Sie nun das nächste Mal mit einer KI sprechen und sie halluziniert, wissen Sie, warum sie das tut. Und wenn sie Zugang zu externen Quellen hat, können Sie sie anleiten, die Antworten in diesen Quellen zu suchen, was mit höherer Wahrscheinlichkeit zum Erfolg führt.

Quellen

Youtube Konferenz ValgrAI - What’s wrong with LLMs and what we should be building instead?